Redes sociales. Facebook valora si elimina su propia cuenta... tras etiquetar erróneamente a hombres negros como 'primates'

Facebook ha deshabilitado una función de recomendación de temas tras asociar erróneamente a hombres negros con "primates" en un vídeo publicado en la red social.

Según El Mundo, un portavoz de la compañía lo ha llamado "un error claramente inaceptable" y dice que el software de recomendaciones involucrado ha sido desconectado:"Nos disculpamos con cualquiera que haya visto estas recomendaciones ofensivas", ha respondido Facebook al ser consultado por Afp. Parece que a Zuckerberg le ha fallado su inteligencia artificial.

El programa de reconocimiento facial ha sido duramente criticado por defensores de derechos civiles, quienes señalan problemas de precisión particularmente con personas que no son blancas.

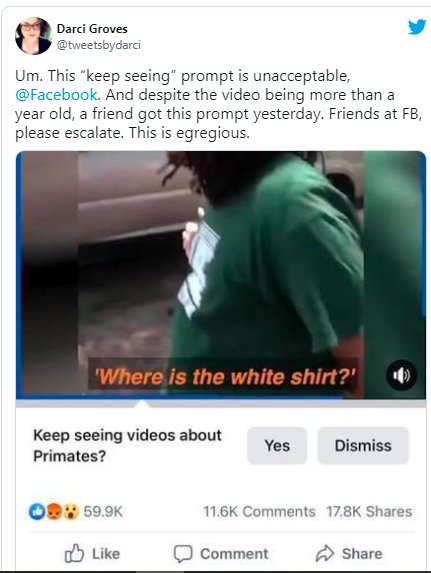

El vídeo de un tabloide británico protagonizado por hombres negros ha recibido en los últimos días numerosas denuncias, tras recibir miles de usuarios un aviso generado automáticamente preguntando si querían "seguir viendo vídeos sobre primates", informa The New York Times.

Darci Groves, ex jefe de diseño de contenido de Facebook, ha compartido una captura de pantalla de la recomendación. "Este aviso de 'seguir viendo' es inaceptable", ha escrito Groves en Twitter. "Esto es atroz".